python,from mrjob.job import MRJob,,class HelloWorld(MRJob):,, def map(self, key, value):, # 将输入数据映射到键值对, yield "hello", 1,, def reduce(self, key, values):, # 将具有相同键的值进行合并, yield key, sum(values),,if __name__ == '__main__':, HelloWorld().run(),`,,这个示例中,我们使用了一个名为mrjob的Python库来简化MapReduce任务的编写。在map函数中,我们将每个输入数据映射到一个键值对("hello", 1),然后在reduce函数中,我们将具有相同键的值相加。通过运行HelloWorld().run()`来执行MapReduce任务。创建HelloWorld应用

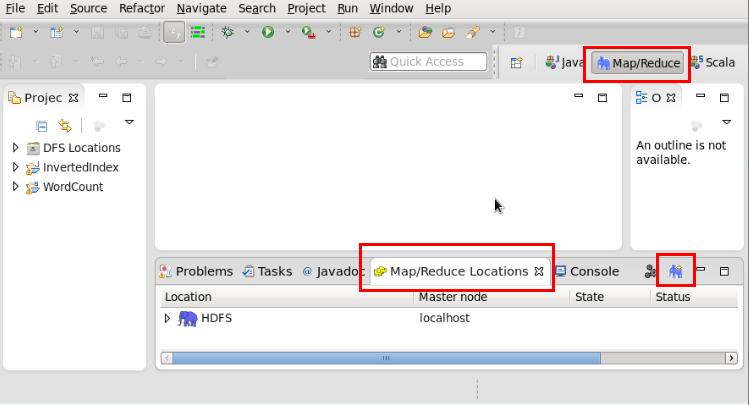

步骤1:安装Hadoop和MapReduce

确保你已经安装了Hadoop和MapReduce,如果没有,请参考官方文档进行安装。

步骤2:编写Mapper类

创建一个名为HelloWorldMapper.java的文件,并编写一个继承自Mapper类的自定义Mapper类,在这个类中,我们将实现map方法,该方法将输入的文本行转换为键值对。

import java.io.IOException; import org.apache.hadoop.io.IntWritable; import org.apache.hadoop.io.LongWritable; import org.apache.hadoop.io.Text; import org.apache.hadoop.mapreduce.Mapper; public class HelloWorldMapper extends Mapper<LongWritable, Text, Text, IntWritable> { private final static IntWritable one = new IntWritable(1); private Text word = new Text(); public void map(LongWritable key, Text value, Context context) throws IOException, InterruptedException { String line = value.toString(); StringTokenizer tokenizer = new StringTokenizer(line); while (tokenizer.hasMoreTokens()) { word.set(tokenizer.nextToken()); context.write(word, one); } } }

步骤3:编写Reducer类

创建一个名为HelloWorldReducer.java的文件,并编写一个继承自Reducer类的自定义Reducer类,在这个类中,我们将实现reduce方法,该方法将Mapper输出的键值对进行汇总。

import java.io.IOException;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Reducer;

public class HelloWorldReducer extends Reducer<Text, IntWritable, Text, IntWritable> {

public void reduce(Text key, Iterable<IntWritable> values, Context context) throws IOException, InterruptedException {

int sum = 0;

for (IntWritable val : values) {

sum += val.get();

}

context.write(key, new IntWritable(sum));

}

}

步骤4:编写驱动类

创建一个名为HelloWorldDriver.java的文件,并编写一个包含main方法的驱动类,在这个方法中,我们将配置和运行MapReduce作业。

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.Path;

import org.apache.hadoop.io.IntWritable;

import org.apache.hadoop.io.Text;

import org.apache.hadoop.mapreduce.Job;

import org.apache.hadoop.mapreduce.lib.input.FileInputFormat;

import org.apache.hadoop.mapreduce.lib.output.FileOutputFormat;

public class HelloWorldDriver {

public static void main(String[] args) throws Exception {

if (args.length != 2) {

System.err.println("Usage: HelloWorld <input path> <output path>");

System.exit(1);

}

Configuration conf = new Configuration();

Job job = Job.getInstance(conf, "hello world");

job.setJarByClass(HelloWorldDriver.class);

job.setMapperClass(HelloWorldMapper.class);

job.setCombinerClass(HelloWorldReducer.class);

job.setReducerClass(HelloWorldReducer.class);

job.setOutputKeyClass(Text.class);

job.setOutputValueClass(IntWritable.class);

FileInputFormat.addInputPath(job, new Path(args[0]));

FileOutputFormat.setOutputPath(job, new Path(args[1]));

System.exit(job.waitForCompletion(true) ? 0 : 1);

}

}

步骤5:编译和运行程序

使用以下命令编译Java文件:

$ javac classpathhadoop classpath HelloWorld*.java

使用以下命令运行程序:

$ java classpathhadoop classpath:./ HelloWorldDriver input_path output_path

input_path是包含输入数据的HDFS路径,output_path是要存储结果的HDFS路径。

问题与解答

问题1: MapReduce中的Mapper和Reducer的作用是什么?

答案1: 在MapReduce框架中,Mapper负责处理输入数据并将其转换为一组中间键值对,Reducer则接收这些中间键值对,并对具有相同键的所有值进行处理,以生成最终的结果,Mapper负责数据的过滤和转换,而Reducer负责数据的聚合和归约。

原创文章,作者:K-seo,如若转载,请注明出处:https://www.kdun.cn/ask/590552.html

微信扫一扫

微信扫一扫